苹果公司(Apple)今天举办年度全球开发者大会(WWDC),宣布旗下人工智能(AI)基础模型将开放开发者运用,加速打造AI应用;苹果高层也证实,需要更多时间来打造更个人化的语音助理Siri,以符合内部的高标准,期待未来一年内能提供更多相关资讯。

苹果在美国加州总部Apple Park举办WWDC,预览多个大幅改版且重命名的操作系统,包括iOS 26、iPadOS 26、watchOS 26、visionOS 26、tvOS 26、macOS Tahoe 26等,并公布个人化智能系统Apple Intelligence的新功能,中央社记者获邀前往现场参加实体特别活动。

苹果首席执行官库克(Tim Cook)在Keynote发表会预录像片开始播放前,亲自登上舞台向现场开发者和媒体开心打招呼,他强调今天是一个重要的日子,充满许多新消息和有意义的链接。

影片来源:Apple

库克说,今天有将近60国的开发者来到现场,还有数百万人在在线观看活动。今年大会将由Keynote发表会揭开序幕,接着举办Platforms State of the Union活动,下午将有机会与苹果工程师交互、进行总部园区导览,再通过一场庆祝活动为今天划下句点,「本周我们想听见你们的心声并交流意见」。

苹果软件工程资深副总裁费德里吉(Craig Federighi)接着上台说,WWDC对于在苹果从事软件工作的人来说,是一段特别的时间,「我们毕生致力于为用户和开发者打造平台,实现我们想要的世界」,并感谢开发者对苹果的启发。

费德里吉在发表会影片表示,苹果已推出强化功能,让Siri变得更直觉且更有帮助。如同先前提到,苹果持续打造让Siri变得更个人化的功能,这项工作需要更多时间来符合内部的高标准,期待未来一年内能提供更多相关资讯。

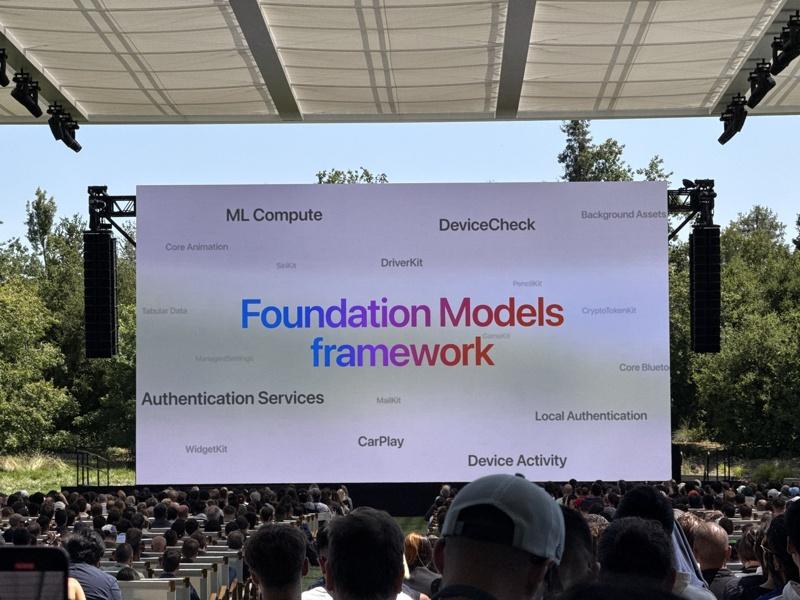

费德里吉也宣布,苹果将通过基础模型框架(Foundation Models framework),让任何App都能直接运用Apple Intelligence内核的设备端基础模型,为开发者直接提供快速、以隐私为内核、可脱机使用,且AI推论免费的强大智能能力,「我们认为这将掀起App智能体验的新浪潮」。

Apple Intelligence为iPhone带来升级体验,帮用户比以往更轻松完成任务,并打开全新的沟通方式和操作画面内容的更多可能。Live Translation集成至「消息」、FaceTime和「电话」中,协助用户跨语言沟通,即时翻译文本与语音内容。

视觉智能(Visual Intelligence)奠基于Apple Intelligence,并延伸至用户的iPhone画面,可在查看任何内容时切换App进行搜索与操作。用户可以针对自己在屏幕上所看见的内容向ChatGPT提问,也能通过Google和其他支持的App搜索类似的图片和产品。视觉智能也能辨识出用户正在查看的活动,并建议将活动加入行事历,同时自动填入日期、时间与地点等重要资讯。