北京时间6月10日凌晨1点,苹果在美国加州库比蒂诺的Apple Park举办WWDC25开发者大会。

大会围绕全新的“Liquid Glass”设计语言、深度集成的苹果智能(Apple Intelligence)、跨设备的无缝协作(Continuity)以及面向开发者的多项新API和工具升级等展开,对包括iOS、macOS在内的全系操作系统进行功能更新和设计变革。

作为大会开篇,Apple Intelligence率先登场,苹果正式为其推出了全新的基础模型框架(Foundation Model Framework),允许第三方开发者接入苹果端侧模型,为应用程序整合包括写作增强工具、智绘表情、图乐园等Apple Intelligence的生成式AI能力。

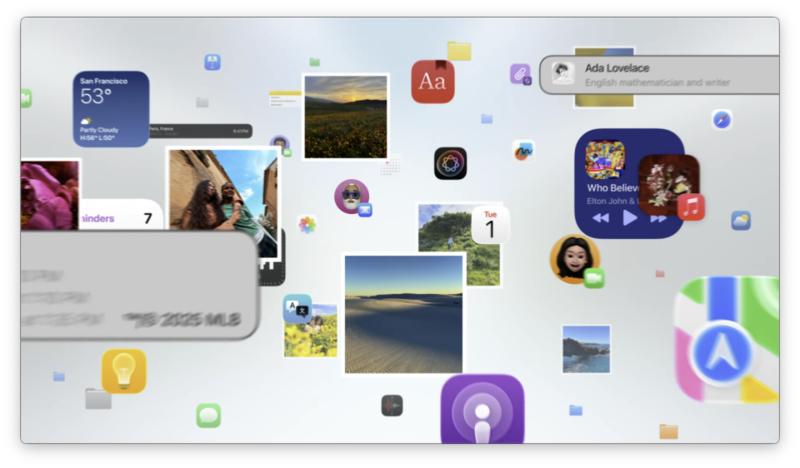

对用户来说,今年苹果在软件层面最大的改进来自于操作系统设计语言——“液态玻璃”(Liquid Glass),苹果表示这也是2013年iOS 7以来首次对UI进行重构。

Liquid Glass设计效果演示

苹果表示,这一改变得益于自研芯片性能的不断增强,新的设计语言打破了软件、硬件之间的界限,苹果软件工程高级副总裁克雷格·费德里吉甚至表示,“基于全平台统一的设计语言,我们现在还把系统名称进行了统一,对应iOS 26、macOS 26等。”

纵观整场发布会,苹果放弃了雄心勃勃的大型语言模型操作系统计划,转而专注于将成熟的AI功能融入到用户日常使用的各个细节中。

这是一种战略调整期的低调,同时也为了向外界证明,虽然模型能力不行,但苹果的产品能力还在。

然而资本市场似乎还是更在乎前者,发布会中,苹果的股价就直线下降,最大降幅曾达到1.44%。

但也许对现在的苹果而言,务实比盲目计划更有意义。

本次主要产品线系统更新如下:

●iOS 26

○采用Liquid Glass设计,时间刻度动态适应背景,支持3D空间效果。

○FaceTime界面更新,支持个性化联系人海报和视频消息预览。

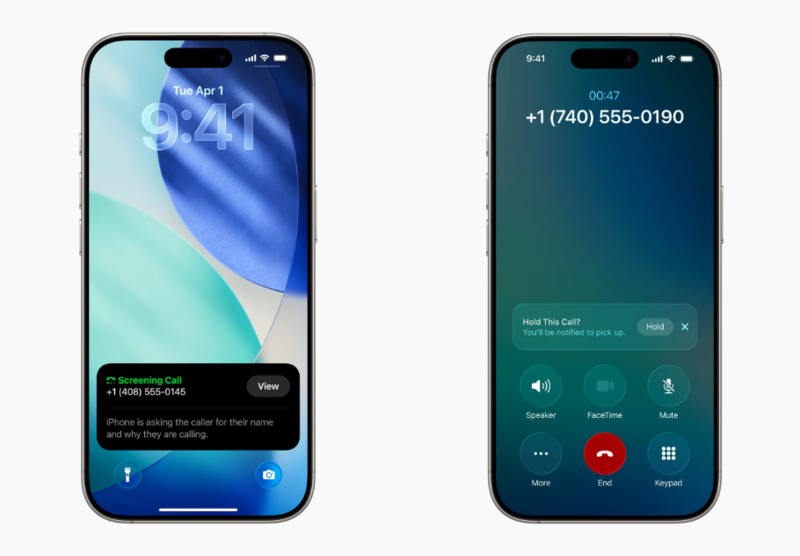

○电话App集成收藏、通话记录与语音信箱,智能语音信箱摘要,电话屏蔽功能可自动筛选骚扰电话,等待通话辅助(Hold Assist)可智能检测等待音乐,自动接听排队变为免打扰状态,来电时再通知用户。

iOS 26对应的防骚扰和排队电话转免打扰状态功能

○消息App支持会话背景共享、群组投票、垃圾短信检测和发信人筛选功能。

○Apple Intelligence增强消息生成表情(Genmoji)和图像创作能力,支持混合Emoji及文本描述产生自定义形象,开放Image Playground新API供开发者使用。

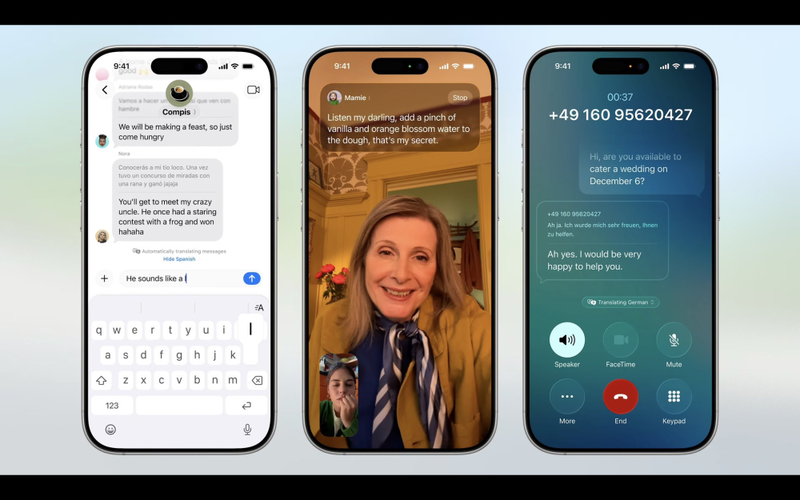

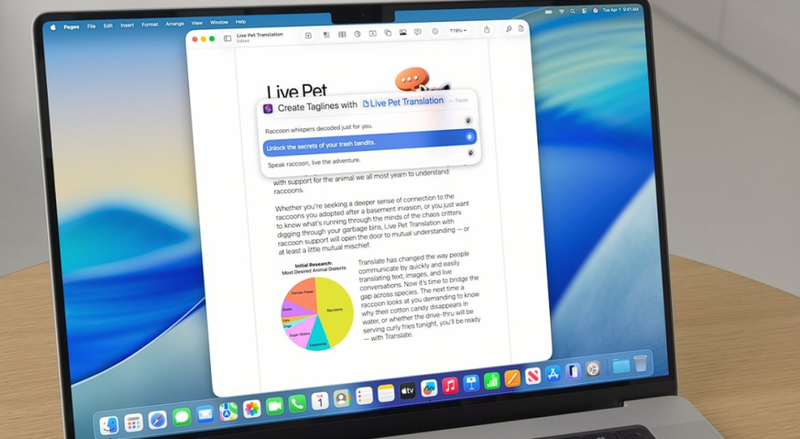

○实时翻译(Live Translation)首次集成消息、FaceTime和电话,实现文本及语音的即时多语言翻译,且全部基于本地模型保障隐私,允许跨iPhone及非iPhone设备通话。

○地图App智能学习日常路线,推送交通拥堵通知和提供替代路线;新增“已访问地点”隐私加密管理。

○新的游戏App集成所有游戏资源,聚合Apple Arcade和社交竞技功能,支持排行榜和挑战功能。

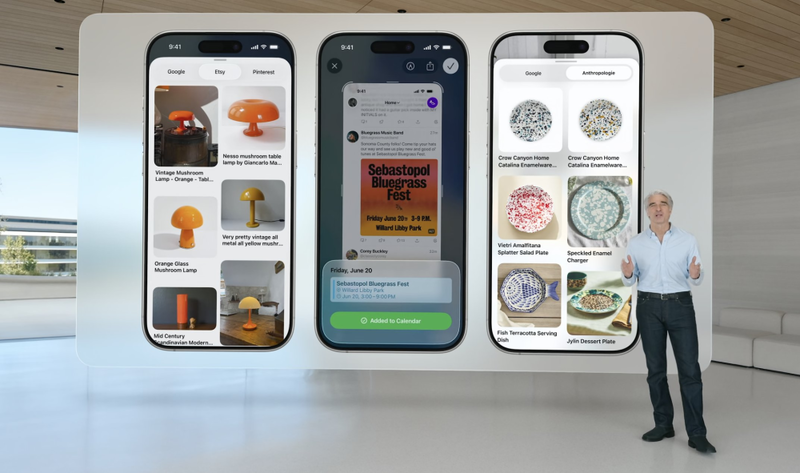

○视觉智能(Visual Intelligence)一键视觉搜索,支持跨App内容识别与操作,如图片搜索相似商品、日程自动添加、知识问答等,开放App Intents集成。

●macOS 26

○新设计语言Liquid Glass落地桌面,提升Dock、图标、侧栏等界面质感与层次。

○菜单栏全透明,支持更多自定义功能,Mac与iPhone应用控件融合共存。

macOS 控制中心更新后的UI

○可个性化文件夹颜色和图标,打造个性化桌面环境。

○Continuity功能升级,支持实时活动(Live Activities)及电话应用,整合等待通话辅助(Hold Assist)和实时翻译(Live Translation)。

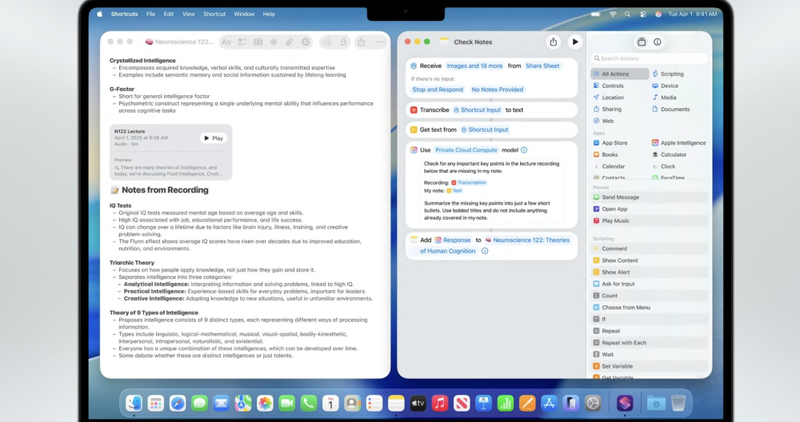

○快捷指令(Shortcuts)自动化增强,支持基于时间或动作触发,集成智能写作和图像生成模块,支持调用本地模型及ChatGPT扩展知识。

○Spotlight搜索功能升级,智能排序、应用操作快捷键(Quick Keys)和剪贴板历史记录一体化,快捷执行发邮件、设置提醒等系统或应用任务。

○游戏体验提升,引入Metal 4技术支持,更强渲染和AI加速,包括即将发布的重度游戏《Crimson Desert》和《inZOI》。

●iPadOS 26

○采用统一的新设计语言Liquid Glass,锁屏、主屏、应用图标重构。

○集成iOS和macOS多项重点功能,如消息群组投票、电话App、游戏App等。

○最大亮点:重新设计的窗口系统,支持多窗口自由调整大小和位置,新增窗口控制按钮和多种分屏布局,提供更灵活的多任务处理能力。

iPadOS 新增的多任务窗口系统

○文件App加强,支持多栏列视图、折叠文件夹和文件默认打开应用设定,支持文件夹拖入Dock快捷访问。

○音频管理支持多输入设备选择,支持独立设置输入麦克风,支持声源隔离功能。

○AirPods录音音质改进,可远程操作视频录制。

○本地高质量音视频捕捉功能支持视频会议App,方便播客制作。

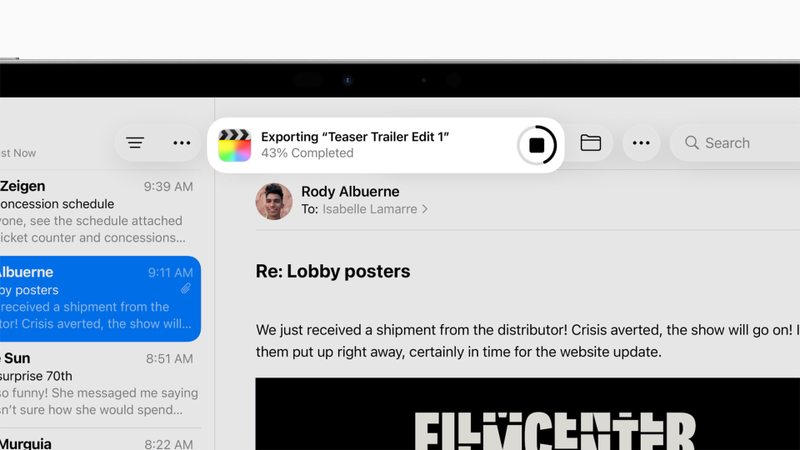

○支持后台任务,长时间导出或处理可在切换应用时持续运行,状态以动态任务显示。

iPad后台任务进度显示

●watchOS 26

○ 融入新设计语言Liquid Glass。

○ 新增“Workout Buddy”锻炼伴侣功能,个性化运动指导与实时数据反馈,提供基于专业教练音色生成的语音夸夸模式。

○ 智能叠放优化,通过融合位置和日常规律精准推送功能模块。

○ 环境声感知自动调节提醒音量,手腕轻弹动作可快速关闭通知及来电静音。

○ Messages支持手表端实时翻译,基于上下文智能建议快速操作。

○ 新增“Notes”应用,方便快速记录查看笔记。

● tvOS 26

○延续Liquid Glass设计,UI在大屏幕上更具层次感和明暗变化。

○Apple TV App强化播放控制透明交互,浏览界面展示电影海报,支持多用户配置,方便家庭成员快速进入自己喜欢的内容。

○Apple Music Sing拓展多人卡拉OK体验,支持iPhone麦克风做声源及多人点歌互动。

tvOS新引入的卡拉OK功能

○开放自动登录API,简化应用跨设备登录体验。

●visionOS 26

○增加空间小组件(Widgets),可自定义尺寸、颜色和深度,持久留存于虚拟空间。

○照片空间场景升级,使用AI计算深度多视角,让2D照片具备立体沉浸感。

空间场景利用新的生成式 AI 算法为照片添加逼真的景深效果

○空间浏览引入沉浸式网页体验,照片和3D物体动态呈现,Web开发工具支持3D内容嵌入。

○支持Vision Pro设备多用户共享,隐私数据可保存在iPhone,加快设备切换。

○企业应用增强,新增保密内容专用API(Protected Content API)。

○配件加入Logitech Muse绘画笔和PlayStation VR2 Sense控制器的支持。

○新增“Jupiter”空间环境,模拟木星风暴等动态天文景观。

玻璃美学:转移注意力的高级操作

本次WWDC最引人注目的变化莫过于”Liquid Glass”设计语言的全面铺开。这个内部代号为”Solarium”的新界面设计,采用半透明的玻璃质感面板,配合悬浮式菜单、圆角设计和动态反射效果,为整个苹果生态系统带来了统一的视觉体验。

但从用户角度看,第一眼的改变并没有那么大。

社交媒体上不少用户将其与Windows Vista的Aero特效相提并论,说这是”Windows Vista借尸还魂”。

但它确实带来一些便捷性。透明、半透明的界面可以让用户在使用App时更容易无负担的打开设置调节。而更小的控制栏位也能让它更不打扰用户对产品的使用。 但这些改变确实没有根本的更改苹果的设计语言:圆角图标和系统排列。

所以你没开半透明模式的话,从界面上根本看不出和之前有什么不同。

但你得承认,这招转移注意力的操作相当高明。当所有人都在讨论新界面是不是抄袭Vista时,就没人追问”新版Siri呢?说好的AI革命呢?”

AI功能:从满汉全席到家常小炒

如果说设计更新是表面功夫,那么AI功能的调整则反映了苹果更深层的战略转变。据彭博商业周刊的深度报道,去年6月苹果展示的AI版Siri演示”几乎全是假的”。一位前苹果员工透露,Siri团队成员对演示内容颇感意外,他们从未见过这些功能可以实际运行的版本。当时演示中唯一在测试设备上激活的新功能,仅是用户唤醒Siri时iPhone屏幕边缘出现的闪烁彩色光带。

内部消息显示,Siri团队原计划打造一小一大两种模型,分别命名为”迷你鼠”(Mini Mouse)和”大力鼠”(Mighty Mouse)。但后来负责人改变主意,决定构建一个全能大模型。这种技术方向的大幅调整让团队疲惫不堪,最终导致公司将Siri新功能发布时间推迟到2026年。

因此,这次WWDC上,苹果软件工程高级副总裁Craig Federighi在主题演讲中明确表示,Siri”还需要更多时间”。

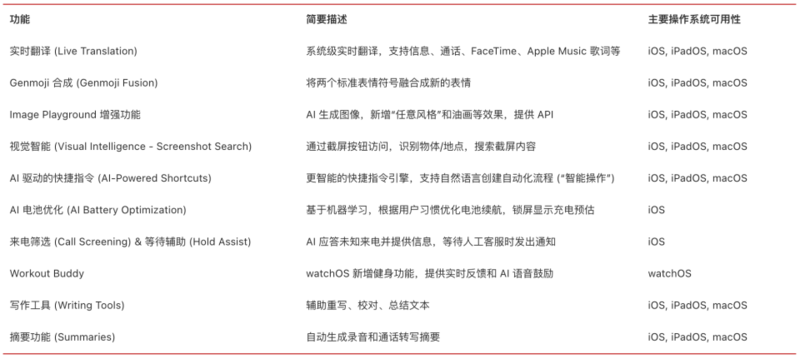

面对这一困境,苹果在本次WWDC上展示了更为务实的策略:放弃大而全的系统,转而在具体功能上精耕细作。没有统一的Apple Intelligence,只有AI功能。

(苹果WWDC 25 AI功能更新一览表)

比如说新推出的Live Translation功能就是这种策略的典型代表。这项功能深度集成到信息、电话、FaceTime通话中,甚至支持Apple Music的歌词翻译。所有翻译均在设备端处理,既保证了用户隐私,又提供了流畅的使用体验。相比谷歌的云端翻译服务,苹果的方案虽然在语言支持上可能有所不及,但在隐私保护和离线使用方面具有明显优势。

另一个小升级则说明了苹果在探索AI能力和用户需求的新结合点——电话自动识别功能。它能帮你直接挡掉你不认识的、大概率是推销和骚扰的电话,只留下静默的语音信箱留言,你都不用接听。而如果AI识别出来这个陌生电话是重要电话,比如外卖等,它会自动给你生成留言总结,然后打开铃声,让你选择接不接。

对于一天接3个以上推销电话的用户来讲,这个功能太及时了。

而去年让用户惊艳的视觉智能(Visual Intelligence)也回退了一步。这次更新版的视觉智能,通过截屏按钮即可访问。她能够识别屏幕上的物体或地点,搜索截屏内容,甚至能在应用内点击图片查找相似商品。还可以调用ChatGPT做问答。

很多人觉得,这不就是淘宝的拍照购物吗?但Apple确实更近了一步,它通过AI智能意图识别推荐能导向更多的任务可能性。比如看到朋友分享的餐厅照片,可以直接获取位置信息并添加到日历中。这些看似简单的功能,却真正解决了用户的实际需求。

而在Maps应用中,AI开始智能学习用户的日常路径并推荐备选方案。这不是简单的导航优化,而是基于用户习惯的个性化服务。再通过“访问过的地点”这些小功能增加用户需求的可用性。

Apple Music的更新同样值得关注。新增的歌词翻译,尤其是发音指导功能,都是AI技术在具体场景中的精准应用。想象一下,听韩文歌时不仅知道在唱什么,还能学着哼两句。这些小地方,也许才是苹果产品的功力所在。

还有一些基于AI能力的功能下放看起来也比较惊艳,比如原来是VisonOS专属的空间智能照片能力下放到IOS,借助AI能让你的手机把2D转为3D照片。这应该能催生不少新玩法。有个3D锁屏,没人会觉得不酷。

Shortcuts和Spotlight,大概是苹果AI这次野心最大的更新了本次更新中最具前瞻性的,算是MacOS的Shortcuts和Spotlight的升级。新的”智能操作Shortcut”功能允许用户通过更自然的语言创建自动化流程,这实际上是让每个用户都能创建自己的小型AI助手。

Spotlight的革新更是彻底改变了其定位。从简单的搜索工具转变为强大的操作中心,用户可以直接在Spotlight中执行数百种操作,无需切换应用。比如能统一搜索结果,智能排序。支持搜索第三方云盘文档,结合个性化推荐和快捷键功能,Spotlight正在成为Mac上Siri之外的一个”超级AI入口”。

你甚至可以直接用它来对App内的内容进行自然语言的操作,比如对文档中的图片做背景去除。

这基本就是个工具化的操作系统Agent雏形了。你用自然语言,就能让它进行系统操作。

不过,它和Apple Intelligent最大的区别是,与其由苹果提供一个无所不能的AI助手,不如给用户工具,让他们根据自己的需求创建个性化的智能体验。这既规避了大型AI系统的技术挑战,又充分发挥了苹果在用户界面设计上的优势。

在技术不成熟时,折中以期更早推出,也许并没什么不好。毕竟谷歌的Astra也还是在饼的阶段,能上桌的也是一个类似功能,能操作系统的Project Mariner。

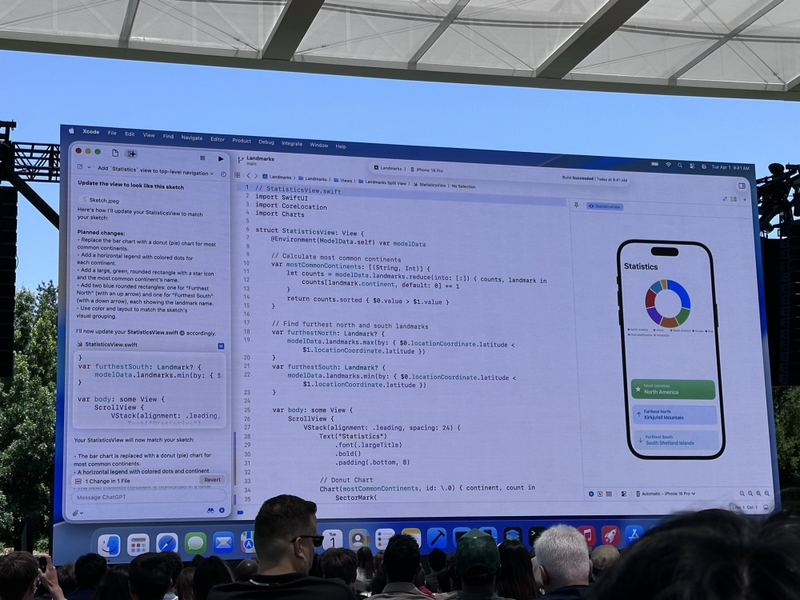

开放生态:承认不足,拥抱合作另一个值得关注的点是苹果在AI领域的开放态度。新发布的Foundation Models框架允许开发者访问苹果的设备端基础模型,使第三方应用能够利用苹果的技术提供摘要生成、写作建议和各种生成式工具 。开发者使用 AI 推理功能也无需支付额外费用 。

在发布会上,苹果多次强调,Foundation Models提供的模型具备强大、快速、私密且可离线运行的特性。这些都可能会是苹果推广自家AI的的关键卖点。这次开放Foundation Models会催生大量具有“苹果特色”AI 功能的应用。

在开放自家模型的同时,苹果也承认自己模型的局限。更加快了外部模型的引入和适配。这次发布会上,苹果与OpenAI的合作更是再进一步。ChatGPT 技术将用于增强 Image Playground 等功能 ,并允许 Siri 在处理复杂查询时调用 ChatGPT 。Xcode也内置了对 ChatGPT 的支持。不过传闻中会在本次引入的Gemini模型并未露面。Claude也仅仅被引入了其 AI 编程助手中,集成在Xcode内。

(Xcode里的ChatGPT)

整体的开放态度也表明了苹果姿态的转变。与其自己先把AI系统做全,不如先让别的应用能用上更原生、贴合苹果系统的AI模型增加功能。用户其实不会管你背后是谁的技术,好用就行。

watchOS的最大更新Workout Buddy,也许是最没用AI功能

然而,并非所有的AI应用都值得称道。watchOS 26中新增的Workout Buddy功能就是一个争议性的例子。这个”AI健身伴侣”会实时分析用户的锻炼数据,并通过生成式语音给予鼓励。

想象一下,当你气喘吁吁地跑步时,手表突然用合成语音说:”加油!你已经跑了3公里,再坚持一下!”这不是鼓励,这是精神污染。有用户说:”我运动就是为了远离电子设备,结果现在连跑步都要被AI骚扰。”

(X上用户发表的被Workout Buddy魔音搞到崩溃的猫猫头meme)

至少从社交媒体的反馈来看,不少用户对此持保留态度。

这个功能的问题在于,它似乎是为了AI而AI,而非真正解决用户需求。相比之下,WatchOS的另一个升级——环境噪音感知自动调节通知音量,虽然技术含量可能更低,但对用户体验的提升却更实在。

另外新手势操作也不错,支持手腕轻拂手势来关闭闹钟和提醒 。很自然,也挺酷的。

iPadOS 26:生产力工具的进化

iPadOS 26的更新清晰地表明了苹果对iPad定位的重新思考。新的”Stage Manager 2.0″允许用户流畅地调整应用窗口大小和位置,通过向屏幕边缘轻扫来平铺窗口,并使用Exposé查看所有打开的窗口。配合新增的Mac风格菜单栏,iPadOS看起来越来越像一个电脑操作系统了。

这些改变指向了iPad不再只是一个大号的iPhone,而是一个能够承担专业工作的设备。这种转变既是对市场需求的回应,也是对Surface等竞品的直接挑战。

不过,这也让Mac和IPad的定位越来越纠缠。

用Mac玩游戏不再被视为“异类”

长期以来,”在Mac上玩游戏”几乎成了一个笑话。

但本次发布的Metal 4也许会改变这一局面。新引擎带来了全局绑定、光线追踪扩展、MetalFX帧插值等技术,这些原本只在高端游戏PC上才能看到的功能,现在也来到了Mac平台。

更重要的是,苹果推出了专门的”游戏”应用,并在系统层面对游戏体验进行了优化。像InZOI这样的大型游戏也登陆了Mac平台了。这几乎是Mac肯定会做的动作,在M系列芯片图像能力越来越强的当下,不涉足游戏市场,纯粹是一种机能浪费。

从iOS 26开始,虽然Mac暂时无法与专业游戏PC相比,但至少它不再是游戏荒漠。

史上最”无聊”的WWDC?也是最务实的WWDC

纵观整场WWDC,苹果展现的是一个终于认清现实的科技巨头。去年画的饼太大,噎住了;今年学乖了,改吃包子。

没有革命性的AI突破?没关系,我们把现有技术用到极致。Siri还是不太聪明?没关系,我们让其他功能更智能。自己的AI不如人?没关系,我们开放平台。

这种转变其实挺好。与其继续吹嘘”改变世界”,不如踏踏实实”改善体验”。毕竟,对普通用户来说,一个能准确识别照片里商品的功能,在现在比一个号称能理解宇宙但经常答非所问的AI助手实用多了。

期望越大,失望越大。苹果这次主动降低期望,反而可能带来一种“进步中的科技最大化应用”的反思。给AI革新的中间层渐进使用做出了很好的演示。

比起画通用、系统的饼,现在的手机AI也许更需要的正是它。

Siri没来!苹果AI终于不画大饼了,中国区依然遥遥无期

北京时间 6 月 10 日凌晨 1 点,苹果准时拉开了一年一度的全球开发者大会(WWDC)的帷幕。但对苹果而言, 这绝非一场寻常的年度盛会。

整整一年前,市场曾对苹果的 AI 寄予厚望,期待其能够兑现 WWDC24 上的承诺,带来革命性的 AI 体验。然而理想是丰满的,现实是残酷的,Apple Intelligence 在过去一年进展缓慢、跳票不断,外界也开始对普遍质疑苹果的 AI 能力,以及未来的潜力。甚至,「苹果没救了」的论调都甚嚣尘上。

在这种背景下,WWDC25 来了。在刚刚结束的首日主题演讲上,苹果也改变了去年 Apple Intelligence「画大饼」的基调,在重重压力下,更务实地选择了在系统底层和基础功能上完善、扩展 AI 化。没有惊艳的突破性进展,但对第三方开发者以及应用生态确实带来不少好的变化。

不过生成式 AI 化的 Siri,依然遥遥无期,苹果软件工程高级副总裁 Craig Federighi 一开场就明确了「coming year(来年)」再议。那么,在这一次WWDC 25上,苹果分享了哪些AI方向上的动态呢?以下是雷科技的报道。

苹果 AI「大转弯」:认清现实,告别幻想

尽管正式演讲中,Craig 用 Apple Intelligence 做了开场,但在简单介绍 Apple Intelligence 已经「交付」的一些功能,并留下「设备端模型」—— Foundation 模型框架面向开发者开放的新消息后,迅速就转向了覆盖各大操作系统的「设计更新」。

图/苹果

事实上,苹果 WWDC25 上明显采取了稳健或者说保守的 AI 策略,而非追求引人注目的创新,提起「Apple Intelligence」的次数明显也比去年少了。总体来说,苹果这次更多是将 AI「有意义地」整合到操作系统或者第一方应用中,以及将「设备端模型」更大程度面向第三方开放。对于很多渴望看到苹果 AI「一鸣惊人」的投资者、媒体和用户来说,可能像泼了一盆冷水。

不过从现实的角度,苹果无论如何也不该重复去年的错误。

简言之,苹果这次在 AI 策略上选择了回归 WWDC 真正的含义——开发者大会。首先就具体介绍了覆盖苹果全部操作系统的全新翻译功能,支持电话(包括与非苹果设备)、FaceTime、Message 以及苹果音乐等等应用,并且面向开发者推出了新的翻译 API。

图/苹果

可以预计的是,第三方开发者一定乐意尝试和拥抱新的翻译 API,并应用在自己的 APP 中,毕竟直接利用了设备端模型和算力,免费的。但实际翻译表现如何,肯定还是开发者最终选择的关键之一。

此外,AI 也终于渗透到了苹果生态的开发端,苹果首次在 Xcode 上引入了 Vibe Coding,并且可以包括 ChatGPT 在内的不同模型。

苹果在智能视觉上也带来了更新。Craig 在 iOS 演讲的末尾带来了一个新的视觉智能功能,可以分析 iPhone 屏幕上的内容,像是对标 Google Gemini 的圈选搜索。但目前来看,这项功能以及更多的视觉智能似乎都由 ChatGPT 提供支持,包括 Image Playground 也支持了 ChatGPT 的图像生成。

只能说,苹果如果还是坚持自主训练大模型,在多模态方面真的要更努力。

与此同时,苹果也继续兑现了一些去年承诺的 AI 功能,包括 watchOS 的 Smart Stack(智能堆叠),基于 AI 预测用户需要的小部件(服务、工具和内容)。而之前传闻的「AI 引入快捷指令」,实际则是以 Intelligence actions 串起「聚焦」+「快捷指令」。

图/苹果

可以说,整体看下来 Apple Intelligence 确实没有太多惊喜,往好了说也避免了之后太多的惊吓。但苹果的执行力仍然是接下来的关键,按照给出的时间表,新系统的第一个开发者 Beta 版本当日即推送,公测版则从 7 月开始,并最终在 9 月推出正式版。

留给苹果 AI 的时间并不多。

从 Siri 到生态,苹果 AI 的冰与火之歌

但说了这么多,这一次的苹果 AI 目前仍然存在「画小饼」的可能,尤其是对于国内用户来说,Apple Intelligence 至今仍未上线,半点影子都还没看到。

事实上,苹果在 WWDC25 上还宣布了 Apple Intelligence 将在今年内推出繁体中文支持,支持中国香港 / 中国澳门 / 中国台湾等市场。至于简体中文的支持,其实已于今年 4 月在海外机型上率先实现,国内的上线时间主要取决于审核的进度。

图/苹果

而苹果,仍然没有给出明确的时间表。

这也包括无数苹果用户心心念念的新版 Siri,苹果在去年就承诺推出生成式 AI 化的 Siri,不仅更自然、更个性化、更深度地集成到系统中,还会具备屏幕感知、个人上下文和更深的应用集成能力,但现实却是一次又一次的推迟。按照演讲中的最新消息,新版 Siri 至少还要等到明年了。

一年之后又一年。可以说,新版 Siri 生成式 AI 化的继续跳票,始终是苹果 AI 战略中最尴尬的地方。更让人担忧的是,苹果这次甚至没有针对新版 Siri 介绍任何可能的进展或者更新,更进一步说明了目前的进展缓慢。

不过,苹果在 AI 时代的优势仍然无法忽略,即便当前功能不算抢眼,底层能力依然具备明显差异化优势。

图/苹果

一方面是在 AI 普遍引发隐私担忧的时代,苹果坚持的「设备端 AI」策略显得尤为突出。这种方法利用针对设备本地处理优化的「小型 AI 模型」,旨在确保「用户隐私和高效处理」的兼顾,而无需依赖基于云的解决方案。对于需要更强大算力的任务,苹果则引入了「私有云计算」——承诺不存储数据,提供「可验证的隐私承诺」。

这种对隐私的「偏执」强调,虽然被认为是苹果 AI 进展缓慢的「元凶」之一,但也是苹果在 AI 领域的核心竞争力。通过在本地或高度安全、透明的云环境中处理敏感数据,苹果旨在建立无与伦比的用户信任,并将其自身与过度依赖集中化、不透明数据处理的竞争对手区分开来。

另一方面,苹果也在 WWDC25 上再次展示了跨系统的生态能力,从基础 AI 能力全线打通 iOS、iPadOS、macOS、tvOS、watchOS、visionOS,再到提供给第三方开发者相应的 API,这是其他厂商都还做不到的,即便是 Google。

图/苹果

而这也意味着,即便当下苹果在 AI 应用上的进展相对缓慢,但实际 AI 在苹果生态渗透的深度和广度都还有一定优势。关键还在于,这种优势还会选择第三方开发者的加入「非线性增长」。

还有一点容易被忽视的是,这次苹果宣布了全生态操作系统的「统一」设计升级,从 iOS 到 tvOS。而统一的设计可以减少了用户的认知负担,使得跨设备(例如在 iPhone 上开始任务,在 Mac 上继续)的 AI 功能感觉更直观、更协调、真正集成。

所以不仅是像 visionOS 的设计风格趋近,这次统一的设计升级可能也是苹果为更深层次、更普遍的 AI 集成做好整个生态系统的准备,确保 AI 驱动的交互感觉原生、流畅和一致,而不是被视为附加功能。

写在最后:苹果AI不求速胜,打持久战

图/苹果

WWDC25 或许在 AI 上没有什么惊喜,但苹果至少走在了正确的道路上,在模型始终无法取得重大突破的情况下,将 AI 通过深层集成、开发者赋能的方式,真正落地到用户的实际体验之中。不求惊艳,但求有用。

或许在短期内,苹果依然会面对 AI 进展落后的压力的批评。但今天不管是 AI 手机、AI PC,还是其他 AI 设备,实际上都处在挖掘 AI 价值的很早期,用户真正能感受到的也很少,苹果还有不少的机会和时间。尤其考虑到苹果强大的生态系统「粘性」——对用户,也对开发者,这将非常有助于第三方 AI 应用的涌现,形成良性循环。

从这个角度来看,WWDC25 可能会是苹果在这场 AI 马拉松中,调整姿态、积蓄力量的关键窗口。