2025上半年的最后一天,华为想「开」了!华为30日宣布开源(开放原代码)盘古70亿参数的稠密模型、盘古Pro MoE 720亿参数的混合专家模型和基于升腾的模型推理技术。这是华为的AI大模型首度开源。

一财网报导,在华为之前,阿里巴巴、腾讯及百度都陆续将大模型开源,集体开源行动背后,既是对AI进入应用为王时代的回应,也有各家加速抢占市场高地、应对国际竞争的战略布局。

一位AI应用从业者分析,去年此时业界讨论开源闭源路线之争时,业界都还在发力底层大模型,究竟哪种模式更好还没得到真正、充分的验证。但很快DeepSeek、阿里已经用事实说明了,开源成为推动AI技术进步和产业发展的重要力量。

在华为内部,对于开源也经历许久的权衡与纠结。例如,从业务层面,基于升腾下的军团以及政企业务线板块的算力买卖或面临着一定的压力。但最终,华为站在了开源大军的队伍里。

华为内部的一位技术专家表示,盘古72B是兼顾性能与推理成本的黄金尺寸,最适合行业用户用AI改造业务,华为以前很少对外发声,盘古也没有开源,所以大家对升腾算力具体的情况不是特别了解,对模型的情况也不了解,外界就充满了猜疑,甚至认为升腾训练不出来先进的大模型,但实际上目前的升腾算力已经具备了训练出世界一流大模型的能力,只有越来越开放,才能让大模型及应用走出实验室。

华为此次开源则选择两款用量相对较多的模型。其中70亿参数的稠密模型部署门槛较低,在智能客服、知识库等多种场景中均可应用,而盘古Pro MoE 720亿参数的混合专家模型更适合处理相对复杂的任务。

华为此前披露,盘古Pro MoE大模型,在参数量仅为720亿,启动160亿参数量的情况下,通过动态启动专家网络的创新设计可以实现「以小打大」的性能,甚至可以达到千亿级模型的性能表现。

而竞争对手的速度并不慢。从2023年至今,阿里通义团队已开源200多款模型,对开源模型竞赛始终保持着高度投入。例如今年春节DeepSeek爆火期间,阿里云就曾连续三个凌晨开源三款大模型,一位接近阿里云的人士透露,目前阿里云的大模型已基本全部开源,所有开源模型均免费使用。

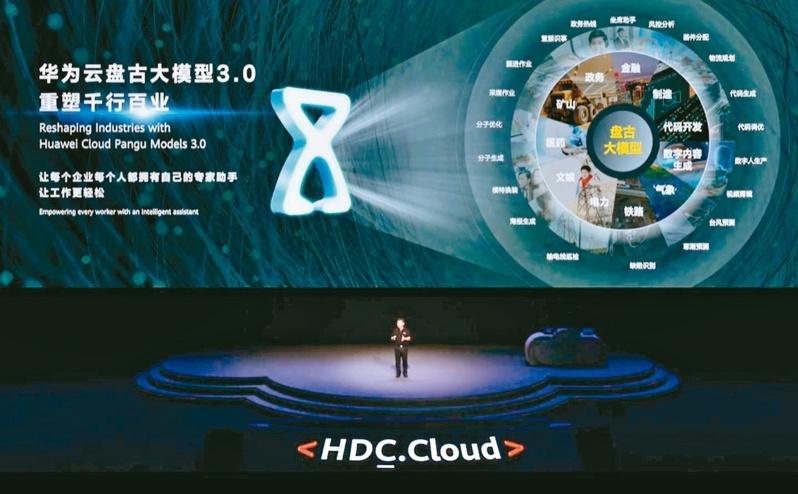

华为30日表示,此举是华为践行升腾生态战略的又一关键举措,推动大模型技术的研究与创新发展,加速推进人工智能在千行百业的应用与价值创造。

从成本角度来看,业界推测,百度、华为之所以在此时选择将相关大模型开源,意味着两家公司已经将成本降得足够低。此前百度董事长李彦宏称大模型推理成本正以每年90%的速度递减。

开源的最终目标仍然是实现商业价值的转化。尽管开源了大模型,开发者还可以选择使用百度、华为智能云的算力服务来进行模型训练、推理和部署。这意味着大模型厂商们仍然可以通过提供高级的企业级解决方案和定制化服务、API接口和云服务等方式实现商业闭环。

对于开源闭源两种路线,也有分析人士指出,开闭源并存的路线共同构成人工智能领域竞争与共生的多元环境,开源趋势会促进和推动行业在这之上的商业化,快速迭代、快速试错、共创共担。但与此同时,业务场景、用户触达不能只靠开源。闭源模型内核逻辑在于能够构成商业闭环,有大量的用户反馈、在固定的渠道里形成壁垒,假设最终其能找到真正击中用户痛点的地方,且通过用户的反馈能够去提升能力,就能占住一个赛道进行商业化变现。

打出开源牌的背后,对华为而言,开源与追赶辉达CUDA生态密不可分。AI新创公司─九章云极的一名内部人士表示,未来在 AI 算力领域,业界对辉达的依赖或将逐步转向多元化选择,这种转变不仅体现在推理环节的技术替代,更将延伸至训练场景的全链条能力重构。

开源也伴生挑战。接近华为人士表示,开源虽带来诸多好处,但也意味着其他企业和开发者可以基于盘古模型进行二次开发,可能会出现一些与华为内部业务竞争的产品或解决方案。这意味着,华为内部业务线需要持续地进行技术优化,从而保持自身的竞争优势。

华为内部人士认为, To B项目的成败跟软件是否开源实质上关联不大,本质上还是看厂商产品能力、交付能力以及对客户需求的理解。但无论是谁,都无法忽视开源的力量,而业界围绕场景落地的较量才刚刚开始 。